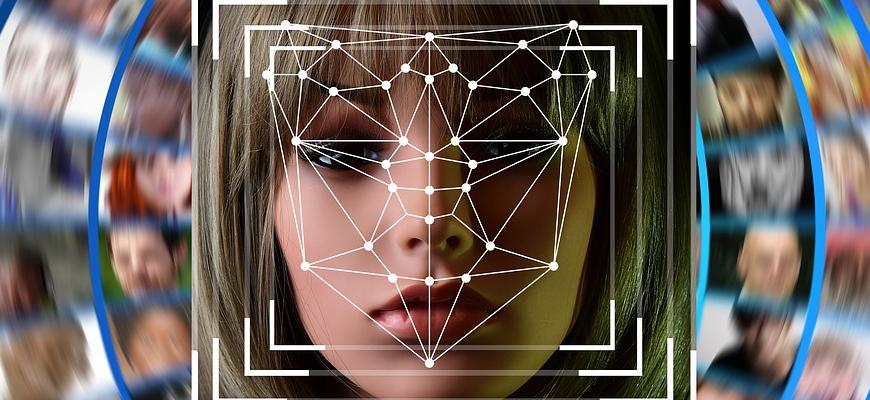

Алгоритм распознавания лиц — сомнительное достижение научной мысли. Он очень удобен власть предержащим, которые стремятся к тотальной слежке за своим населением. Он также соблазнителен для использования в коммерческих целях. Но научные мужи во всём мире предупреждают, что поощрять такие исследования, которые ведут к слежке за добропорядочными гражданами (пока не доказано другое) недопустимо.

Как сообщает редакция научного журнала Nature, учёные всё чаще призывают к выработке единого мнения в отношении этичности подобных исследований. Призывы звучат со страниц научных изданий, на конференциях, и исследователи отказываются от работы с организациями, запятнавшими себя неэтичными проектами. Даже те, кто волей-неволей принимал в них участие, пересматривают их и стараются более тщательно анализировать методы сбора и распространения данных распознавания лиц.

Всё началось с китайцев, которые в 2018 году инициировали создание алгоритма, позволяющего распознавать лица уйгуров (мусульманского меньшинства в Китае), отличая их от корейцев и тибетцев. Руководство КНР «вложилось» в такого рода исследование в северо-западной провинции Синьцзян под предлогом борьбы с террористической угрозой. В 2019 году редакции журнала Wiley поступило предложение убрать это исследование из своей научной базы. Причина проста — СМИ выяснили, что данные были собраны незаконной установкой видеокамеры без согласия участников эксперимента.

С тех пор учёные заняли более твёрдую позицию в отношении таких исследований. Они подчёркивают, что сбор данных в большинстве случаев незаконен. И этим грешат не только китайцы.

Так, в 2015 году ученые из Стэнфордского университета брали снимки из кафе, исследователи Вашингтонского университета в 2016 году — из Интернета, Университет Дьюка в Дареме — из студенческого кампуса. Некоторые из них использовались затем, например, компаниями, работавшими над военными проектами в Китае. Всего было выявлено не менее 900 проектов, в которых учёные нарушили права людей.

Иногда к исследователям предъявляют претензии, обиженные люди подают иски в суд, если это позволяет местное законодательство. Но, как с грустью отмечает научное сообщество, даже регулирование защиты данных Европейского союза (GDPR) не определяет правил игры. Вот и остаётся учёным самим разрабатывать этические нормы и не пускать в своё сообщество тех, кто выполняет заказы сомнительного свойства. Всё отдано на откуп научной репутации как эффективному институту проблем этики.

Для дальнейших шагов надо придти к согласию в собственном кругу. А, как показывает опрос Nature, до этого ещё далеко.

На данный момент только 40% учёных согласно с тем, что информированное согласие людей — это необходимое условие для использования их данных в науке. Остальные же не считают это необходимым. Но 71% учёных понимает, что проверить получение согласия каждого их десятков тысяч человек физически невозможно, поэтому этика должна состоять прежде всего в недопущении попадания результатов .в недобросовестные руки силовиков или вовсе криминала.

Консенсус склоняется к тому, чтобы ограничивать не исследователей, а неэтичное применение алгоритма распознавания лиц. «Существует ряд законных и полезных применений распознавания лиц и биометрических данных, которые нам нужны в нашем обществе», — говорят учёные. Например, для поиска пропавших детей.

И вот тут учёные попадают в этический капкан, из которого не смогут выбраться. Если большинство проектов, как говорят в редакции Nature, создаются с нарушением прав людей, то выходит, что они по сути неэтичны. Так как может быть этичным участие в таких исследованиях? Потому, что они когда-то кому-то помогают? Но и люди, умеющие взламывать замки, могут понадобиться, если вы забыли дома ключи. Помните, что и известный кинозлодей Ганнибал Лектор кому-то помог своим бесценным опытом?

Проблему этичности создания алгоритмов распознавания лиц нужно рассматривать и в России, где они взяты на вооружение властями. Закон у нас на стороне силовиков — вспомните иск москвички Алёны Поповой по использованию видеокамеры с целью наложения на неё штрафа за пикет у здания Госдумы. Суд решил, что государство вправе это делать, поскольку он собирает базу данных без личной информации, и лишь по решению суда устанавливает владельца изображения. Закон — что дышло, куда повернёшь…

Знают наши учёные, как будут использоваться собираемые ими данные. Этично ли принимать в этом участие только потому, что создавая инструмент тотального слежения, наука сможет помочь одному из миллиона закабалённых людей?